刚刚,Seedance 2.0最强对手上线!这就是AI视频的「Nano Banana 时刻」

刚刚,Seedance 2.0最强对手上线!这就是AI视频的「Nano Banana 时刻」不出所料,之前爆料的 Gemini Omni 正式发布了。

搜索

搜索

不出所料,之前爆料的 Gemini Omni 正式发布了。

2026年5月13日,作为每年 Google I/O 的前哨站,同时也是关于最重要的部分——安卓的独立发布会,The Android Show在线上开幕,揭开了 2026 年 Google 在 Android 领域全系产品阵容的新品发布阵容。

Chrome正在把你的电脑变成它的AI算力节点,没问过你,没通知你,而且删了还会自动重下。

今天凌晨,谷歌 Gemini 突然放大招,它在 X 上宣布:现在 Gemini 可以直接生成PDF、Word、Excel 或 Google Workspace 等文件,无需上传模板,只用和Gemini交流要做什么和讲清文件格式。

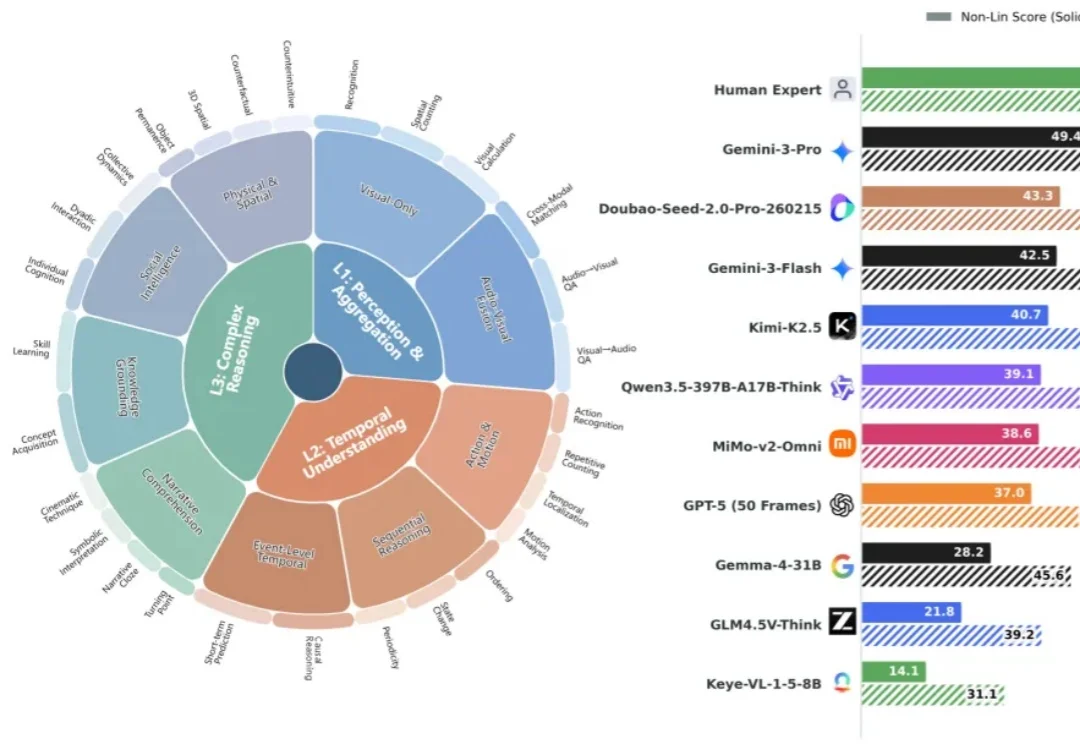

现有大模型评测分数日趋饱和,但与真实体验差距显著。南京大学傅朝友团队牵头,在 Google Gemini 评测团队邀约下推出视频理解新基准 Video-MME-v2。凭借创新的分层能力体系与组级非线性评分,以及 3300 + 人工时高质量标注,揭示模型与人类的巨大鸿沟(49 vs 90)、传统 Acc 指标虚高、以及 “Thinking” 并非总是增益等现象。

现有大模型评测分数日趋饱和,但与真实体验差距显著。南京大学傅朝友团队牵头,在Google Gemini评测团队邀约下推出视频理解新基准Video-MME-v2。凭借创新的分层能力体系与组级非线性评分,以及3300+人工时高质量标注,揭示模型与人类的巨大鸿沟(49vs90)、传统Acc指标虚高、以及「Thinking」并非总是增益等现象。

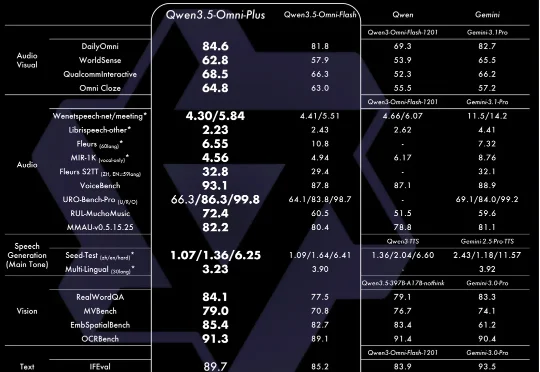

阿里刚刚发布了最新一代全模态大模型 Qwen3.5-Omni,在通用音频理解、推理、翻译和对话等维度,已全面超越 Gemini 3.1 Pro。所谓全模态,在于它拥有了接近人类的“感官”。它能听、能看、能说、能写。

就在刚刚,据彭博社报道,iOS 27 将引入一套名为「Extensions」的新机制,允许用户通过设置面板,把 Google Gemini、Anthropic Claude 等第三方 AI 接入 Siri,就像现在调用 ChatGPT 一样直接从 Siri 发起请求。

香港用户终于等来了这一天——谷歌宣布将逐步向香港开放 Gemini 网页应用,这意味着以后再也不需要翻墙 VPN 就能用上谷歌的 AI 助手了。在此之前,使用香港网络的用户一直无法直接访问 Gemini,需要借助 VPN 等「曲线救国」的方式才能使用。

Google 最近发了 Gemini Embedding 2,他们第一个原生多模态向量模型。文本、图像、视频、音频、文档,全部映射到同一个 3072 维向量空间。这是 Omni Embedding(全模态向量模型)的大趋势:一个架构吃下所有模态,从 jina-embeddings-v4 到 Omni-Embed-Nemotron 再到 Omni-5,大家都在往这个方向收敛。